Taktile Displays für Virtual-Reality-Anwendungen

| Leitung: | Dr.-Ing. Jenns Twiefel |

| E-Mail: | mailto:twiefel@ids.uni-hannover.de |

| Jahr: | 2019 |

| Förderung: | DFG |

Die potenziellen Anwendungsgebiete für taktile Ausgabegeräte sind vielfältig. Neben der Unterhaltungsindustrie und dem E-Commerce bieten sich auch die virtuelle Prototypenentwicklung und das virtuelle Training als Anwendungsbereich an. Ein Einsatz als Feedbackgeber in der Medizintechnik, der Fahrzeug-und Maschinensteuerung sowie für die sensorische Unterstützung von Blinden ist ebenfalls vorstellbar.

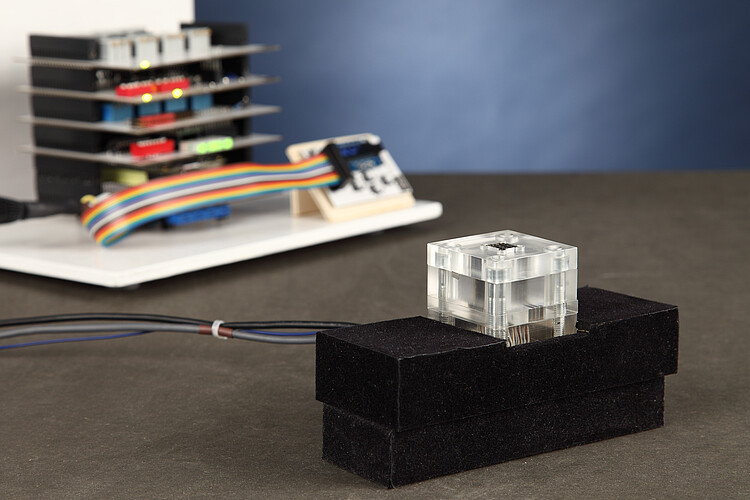

Aus dem laufenden Projekt entstand bereits ein prototypisches taktiles Display, welches in eine Computermaus integriert wurde. Dieses Display ermöglicht eine Aktivierung der Haut über Schereffekte. Die dabei von den Aktorelementen des taktilen Displays erzeugten Schwingungen mit Amplituden im μm- Bereich sind daher - basierend auf einem physiologischen Modell des Tastsinns - so gewählt, dass an der Fingerkuppe eine Anregung entsteht, die den gewünschten Tast-Eindruck hervorruft. Es wurde auch eine entsprechende Software implementiert, bei der mit der Maus über verschiedene virtuelle Oberflächen gefahren werden kann. Das besondere daran ist, das auch die Geschwindigkeitsinformationen mit in die Reizerzeugung einfließen und so eine realistischere Wahrnehmung generieren.

Nachdem die grundsätzliche Machbarkeit gezeigt werden konnte, wird nun der menschliche Wahrnehmungsprozess intensiv untersucht, um die Eigenschaften der nächsten Displaygeneration noch besser anzupassen.

Ein neues Display Konzept mit gekoppelten Aktoren sieht vor die für die Erzeugung von Hautscherungen verantwortlichen piezoelektrischen Biegeaktoren mit Aktoren zu koppeln, die eine Anregung normal zur Haut ermöglichen. Diese Normalkraftaktoren basieren auf dem Reluktanzprinzip. Vom IDS kommen die piezoelektrischer Biegeaktoren. Die Normalkraftaktoren, werden vom Institut für Mikroproduktionstechnik entwickelt.

Auf Basis des im wesentlichen vom Welfenlab entwickelten Wahrnehmungsmodells, erfolgt die Displayansteuerung. Zur Beschreibung des Aktorverhaltens des piezoelektrischen Biegeaktors wurde bereits ein analytisches Aktormodell aufgestellt sowie die vom Finger ausgehenden Kontaktlasten gemessen und in ein Lastmodell übersetzt.